Capacidad de aprendizaje y complejidad del modelo#

Ultima modificación: 2023-03-11 | YouTube

Un MLP puede aprender relaciones no lineales.

Un MLP puede aprender en tiempo real (on-line learning) con el método

partial_fit

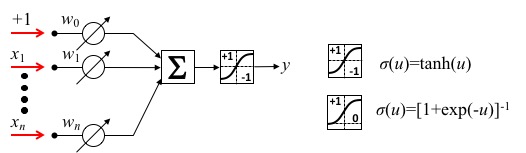

Teorema de aproximación universal. Una función de la forma:

f(x) = \theta + \sum_h m_i * \sigma \left( \sum_i w_{i, h} x_i + b_h \right)

donde \sigma(\cdot) es una función sigmoidea estrictamente creciente, puede aproximar con una precisión arbitrariamente pequeña, un conjunto de puntos (x_p, y_p) definidos en un dominio compacto

El teorema indica que existe un modelo de redes neuronales pero no indica como obtener la cantidad de neuronas ocultas ni como estimar los parámetros.

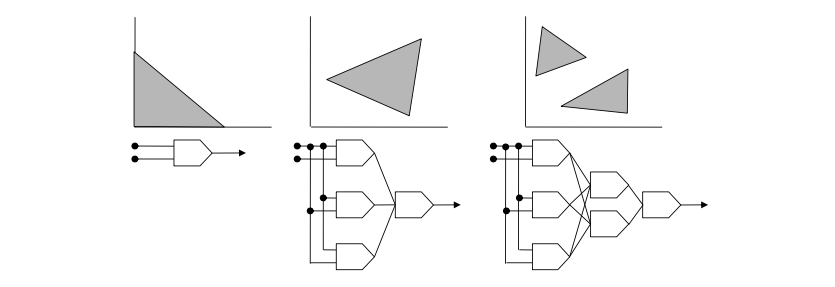

En problemas de clasificación, la frontera generada por un perceptrón simples es una linea recta.

Un perceptrón multicapa puede generar una superficie compacta donde la región sombreada representa una clase y el resto de la superficie representa la otra (figura del centro). Cada uno de los bordes del polígono es generado como la frontera de decisión que produce cada perceptrón de la capa oculta. La neurona de salida implementa la función lógica AND o la función lógica OR. Si cada perceptrón de la capa oculta indica la pertenencia de un punto cualquiera a la región sombreda, entonces la neurona de salida representa un AND (todos los perceptrones de la capa oculta deben indicar que el punto pertenece a la región sombreada). De forma análoga, si los perceptrones de la capa oculta indican la no pertenencia a la región sombreada, entonces, la neurona de salida debe representar un OR. Esto implica (de forma intuitiva) que un perceptrón con una capa oculta puede aproximar cualquier función continua definida en un dominio compacto

Una red con dos capas ocultas puede resolver problemas de clasificación donde los elementos de la clase de interés están aglomerados en distintas regiones (ya no hay un dominio compacto). Si se tiene en cuenta que cada región compacta puede ser generada por u perceptrón con una capa oculta, entonces se requieren dos percptrones los cuales son unidos mediante una capa adicional (al final) que representa un OR lógico.